Startup Portfolio

Googleの半導体部門出身社が設立したNvidiaと直接競合するAIチップ・スタートアップの"MatX"がSeries Bで$500M超を調達

MatXは、Jane Streetおよび元OpenAI研究者のLeopold Aschenbrennerが設立した投資会社Situational Awarenessがリードし、同社のSeries AをリードしたSpark CapitalおよびMarvell Technology、NFDG、そしてStripeの共同創業者であるPatrick CollisonとJohn Collisonなどが参加したSeries Bで$500M超を調達しました。

2022年にGoogleの半導体部門出身の元エンジニアであるReiner PopeとMike Gunterによって設立されたNvidiaと直接競合できるAIチップ・スタートアップのMatXは、AIチャットボットを支える技術である大規模言語モデル向けに最適化されたチップを設計しています。

「今回のラウンドにより、多額の資金を持つプレイヤーとほぼ同じ土俵に立つことができました。この資金により、MatXは製造スペースおよび重要部品、特に現在半導体業界で不足しているメモリを確保できるようになります。」とMatXの共同創業者兼CTOのGunterは述べています。

MatXは、MatX Oneと呼ばれるチップを開発しています。このチップは、AIトレーニング向けにNvidiaやGoogleが使用している高帯域幅メモリ(HBM)と、より高速な推論処理のための静的ランダムアクセスメモリ(SRAM)を組み合わせています。このデュアルアプローチは、高スループットと低レイテンシの両立を目的としています。

「同一製品内でその両方を実現することは実際に可能であり、その結果としてはるかに優れた製品が生まれます。社内テストでは、同チップは主要な効率指標である平方ミリメートルあたりの計算性能において、Nvidiaの次世代Rubin Ultraを上回る可能性が示されています。」とMatXの共同創業者兼CEOのPopeは述べています。

このハードウェアは大規模AIアプリケーションを支援することを目的としています。GPT-4のような高度なモデルのトレーニングや、ChatGPTに類似したアプリケーションの運用が可能です。これにより、高性能AIがより小規模なスタートアップやAIラボにも利用可能になります。

現在MatXには約100名のメンバーが在籍しており、さらなるエンジニアを迅速に募集しています。同社は大規模な営業チームの構築にはあまり関心がなく、最高水準のパフォーマンスを重視するトップAIラボに直接アプローチしています。

今年中にチップ設計を完了する予定です。製造はTSMCが担当します。今回の資金調達により、MatXは生産枠を確保し、必要な部品を調達できるため、チップ完成後すぐに出荷できる体制を整えられます。

AIチップ市場は長年にわたりNvidiaのGPUが支配してきました。MatXのような新規参入企業は、性能、ソフトウェア互換性、信頼性、製造規模など複数の側面で既存企業に匹敵する必要があります。

「市場に存在する製品と少なくとも5つほどの重要な側面で並ぶ必要があり、そのうち少なくとも1つでは大きく上回らなければなりません」とMatXの共同創業者兼CEOのPopeは述べています。スタートアップは一つの強みに集中しすぎて他の領域を軽視すると失敗することが多いとも指摘しています。

OpenAIやAnthropicのようなLLM開発企業は、複数のチップサプライヤーやクラウドプロバイダーを利用する傾向を強めています。このトレンドはMatXや他の新規参入企業にとって機会を生み出しています。

MatXは、インテリジェンスをすべての人にアクセス可能にすることを目指しています。同社の技術は、医療アドバイス、家庭教師、コーチング、パーソナルアシスタンスなどの専門AIサービスを支援できる可能性があります。スピードと効率性を組み合わせることで、これまで大規模ラボに限られていた能力をより小規模な組織にも提供することを目指しています。

今回のSeries Bでは、AlchipやMarvellを含むサプライチェーン全体の投資家も参加しました。これらの支援により、重要な製造およびメモリ部品の確保が可能になります。同社は正確な評価額を開示していませんが、現在の企業価値は数十億ドル規模であると述べています。

MatXの戦略は、トレーニングと推論の両方の性能を最大化するチップを開発することに焦点を当てています。大規模モデル計算にはHBMを活用し、低レイテンシ処理にはSRAMを活用することで、優れた製品を提供できると考えています。

MatXは2027年に最初のチップを出荷する計画です。今回の資金調達により、開発を加速し、生産体制を強化しながらも遅延なく進めることが可能になります。また、AIラボと協議を進めており、実際のプロジェクトでチップをテストし、実製品への導入を目指しています。

MatXは、AIハードウェア分野で既存大手企業に挑戦する新世代スタートアップの一角を担っています。異なるメモリ技術を組み合わせ、大規模言語モデルに特化するアプローチは、AIインフラの展開方法を変革する可能性があります。

投資家や業界関係者はMatXの動向を注視しています。同社の成功は、これまで少数の大手企業が支配してきたAIチップ市場に変化をもたらし、小規模ラボにも強力なハードウェアへのアクセスを提供する転換点となる可能性があります。

関連ニュース

MatX に興味がありますか?

最新ニュース

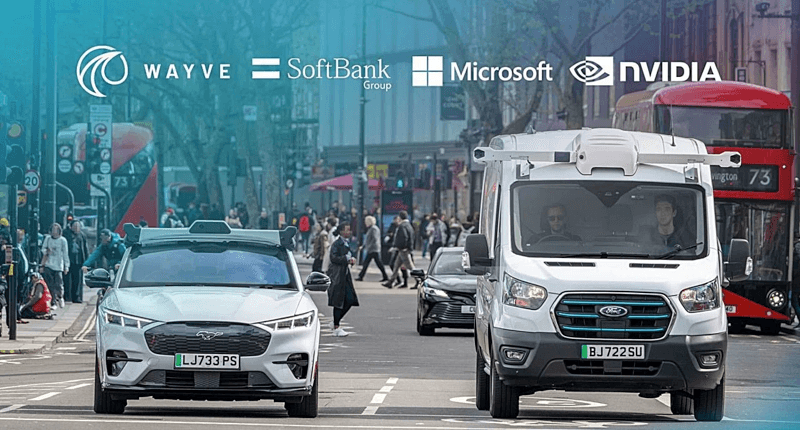

イギリス・ロンドンを拠点とするAI自動運転スタートアップの"Wayve"が最大で$1.5Bを調達し評価額は$8.6Bに拡大

2026/02/25

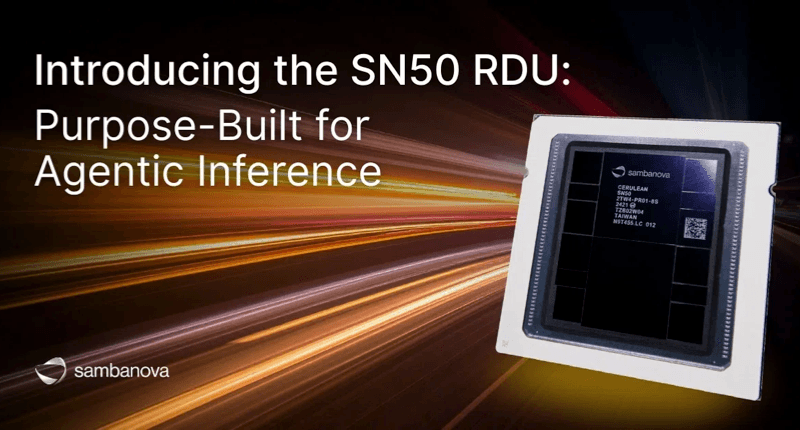

GPUに代わる選択肢を提供するAIチップメーカーの"SambaNova"がSeries Eで$350Mを調達し、Intelとの協業を発表

2026/02/25

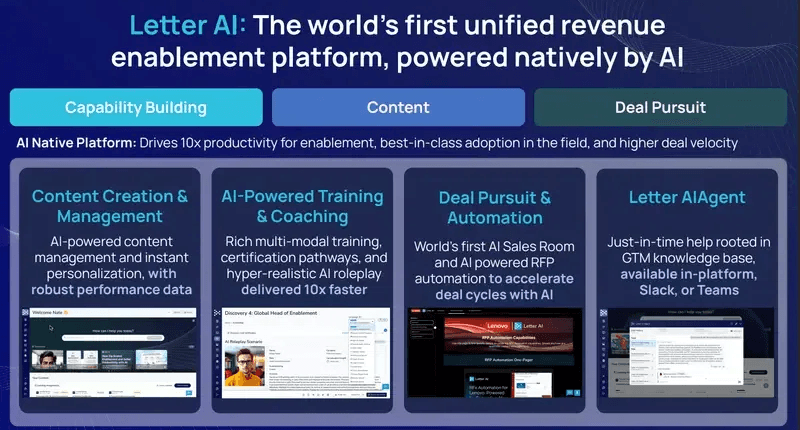

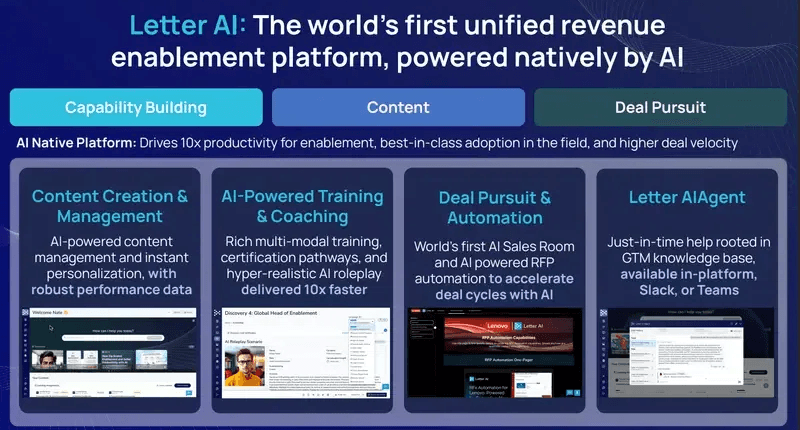

GTMチーム向けのAIネイティブなrevenue enablementプラットフォームの"Letter AI"がSeries Bで$40Mを調達

2026/02/25

会計事務所向けのAIエージェントを開発する"Basis"がSeries Bで評価額$1.15Bで$100Mを調達

2026/02/25

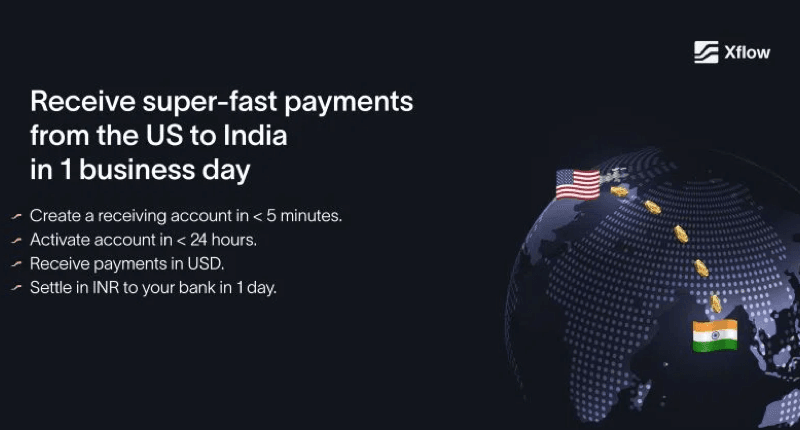

インドのFinTechスタートアップでクロスボーダーB2B決済の"Xflow"がSeries Aで$16.6Mを調達し評価額が$85Mに拡大

2026/02/24